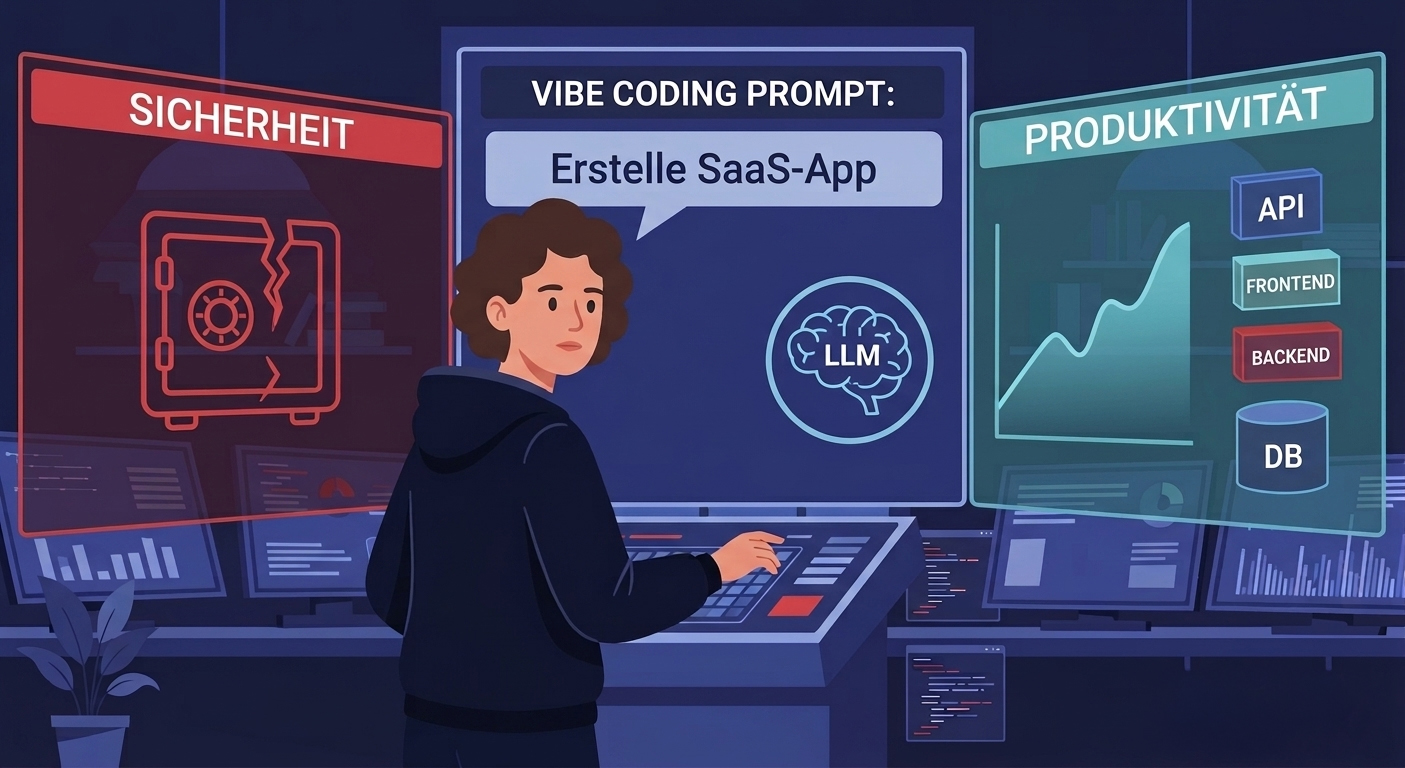

Künstliche Intelligenz verändert die Softwareentwicklung gerade fundamental. Tools wie Cursor, Claude Code, GitHub Copilot oder Open AI Codex ermöglichen es, nicht mehr nur einzelne Code-Snippets, sondern komplette Anwendungen zu entwickeln: Frontend, Backend, Datenbankanbindung, Authentifizierung, Deployment-Pipeline, generiert durch einen einzigen Prompt. Der Begriff dafür: Vibe Coding.

Was ist Vibe Coding überhaupt?

Der Begriff wurde Anfang 2025 populär und beschreibt einen Entwicklungsansatz, bei dem Software primär durch natürlichsprachige Prompts entsteht. Dabei beschreibt der Entwickler nicht mehr die konkrete Implementierung, sondern lediglich die gewünschte Funktionalität. Die eigentliche Softwareentwicklung übernimmt das LLM.

Erstelle eine SaaS-Anwendung mit Benutzerverwaltung, Stripe-Integration, Admin-Panel und E-Mail-Workflow.Wenige Minuten später existiert häufig bereits ein lauffähiger Prototyp.

Technologisch betrachtet ist das wenig überraschend. Programmiersprachen sind hochstrukturierte formale Sprachen. Und genau darin sind Large Language Models außergewöhnlich gut. Die Produktivitätsgewinne sind real. Entwicklungszeiten reduzieren sich massiv, Iterationen werden schneller und selbst komplexere Features lassen sich in kurzer Zeit prototypisieren. Das Problem beginnt dort, wo die Komplexität der Systeme schneller wächst als das Sicherheitsverständnis der Entwickler.

Vom Code-Assistenten zur autonomen Implementierung

Ursprünglich wurden KI-Systeme hauptsächlich als Unterstützung für kleinere Entwicklungsaufgaben genutzt: „Schreibe eine Funktion zur Verarbeitung von Formulardaten.“

Mittlerweile werden jedoch komplette Systemarchitekturen generiert:

- Multi-Tenant-Webanwendungen

- Payment-Integrationen

- OAuth-Authentifizierung

- RBAC-Systeme

- Echtzeitkommunikation

- Containerisierte Deployments

- CI/CD-Pipelines

Und genau für diese Workflows optimieren die großen Anbieter ihre Produkte. Cursor integriert autonome Agenten, Claude Code generiert vollständige Featuresets und Codex verfolgt zunehmend den Ansatz eines vollständig KI-gesteuerten Entwicklungsprozesses. Die Rolle des Entwicklers verschiebt sich dadurch fundamental zu weniger Implementierung und mehr Orchestrierung. Oder anders formuliert: Der Mensch entwickelt nicht mehr selbst, er überwacht lediglich die Generierung.

Cognitive Offloading: Wenn niemand den Code wirklich versteht

Ein zentraler Effekt beim Vibe Coding ist sogenanntes Cognitive Offloading. Denkarbeit wird an externe Systeme ausgelagert. Entwickler überprüfen generierten Code nicht mehr vollständig, sondern verlassen sich darauf, dass die KI „wahrscheinlich etwas Sinnvolles produziert hat“. Bei kleinen Komponenten funktioniert das häufig noch problemlos. Bei größeren Anwendungen entsteht jedoch ein massives Problem. Niemand besitzt mehr ein vollständiges Verständnis des generierten Systems und Sicherheitsentscheidung bleiben auf der Strecke:

- Ist die Authentifizierung korrekt implementiert?

- Werden Berechtigungen sauber geprüft?

- Existieren Zugriffskontrollen?

- Sind Secrets geschützt?

- Gibt es sichere Input-Validierung?

- Wurde Rate Limiting berücksichtigt?

- Ist die Session-Verwaltung sicher?

Denn während Funktionalität sichtbar ist, bleiben Sicherheitsfehler oft unsichtbar, bis sie aktiv ausgenutzt werden.

Das eigentliche Problem: Sicherheit skaliert nicht automatisch mit

LLMs sind beeindruckend gut darin, funktionierenden Code zu erzeugen. Funktionierend bedeutet jedoch nicht automatisch sicher.

Eine Untersuchung von Veracode zeigte, dass rund 45 % KI-generierter Code Sicherheitsprobleme enthält. Besonders häufig betroffen waren:

- SQL-Injections,

- XSS,

- Broken Access Control,

- fehlende Input-Validierung.

Noch problematischer wird die Situation bei vollständig KI-generierten Anwendungen.

Laut ScanVibe enthalten:

- über 60 % der analysierten Anwendungen exponierte Secrets oder API-Keys,

- rund 70 % fehlerhafte Supabase-RLS-Konfigurationen,

- etwa 90 % fehlende oder unvollständige Security-Header.

Technisch betrachtet ist das wenig überraschend. LLMs optimieren primär auf Wahrscheinlichkeit, nicht auf Sicherheitsgarantien. Das Modell erzeugt die statistisch plausibelste Fortsetzung eines Musters. Sicherheit ist dabei lediglich ein Nebeneffekt des Trainingsmaterials.

Studien zu GitHub Copilot zeigen, dass AI-Coding-Assistenten bestehende unsichere Muster nicht nur übernehmen, sondern auch verstärken können, etwa durch fehlende Authentifizierungsprüfungen oder hardcodierte Secrets.

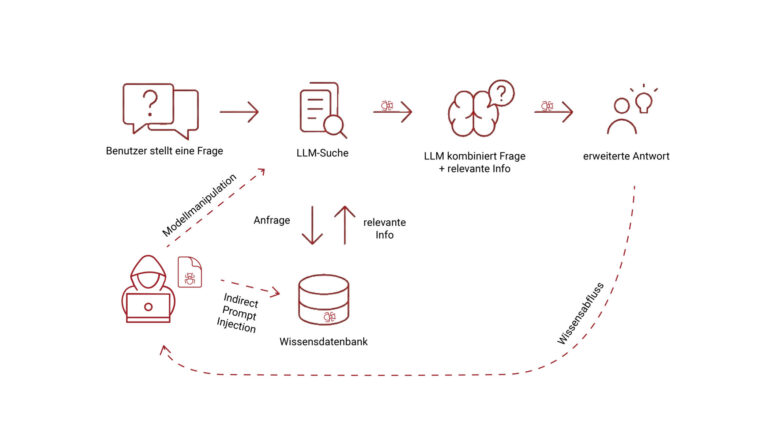

„Aber die KI scannt den Code doch inzwischen selbst“

Natürlich reagieren die Anbieter auf diese Probleme. Claude integriert Sicherheitsanalysen, GitHub Copilot bietet automatisierte Reviews und moderne Coding-Agenten führen statische Analysen während der Generierung aus. Das reduziert bestimmte Klassen klassischer Schwachstellen durchaus.

Die Grundproblematik bleibt jedoch bestehen: Nichtdeterministische Systeme erzeugen sicherheitskritischen Code, der anschließend durch weitere automatisierte Systeme geprüft wird. Vor allem Architekturprobleme lassen sich dadurch nur begrenzt erkennen. Mehrere aktuelle Untersuchungen zeigen, dass selbst KI-basierte Security-Reviews kritische Schwachstellen regelmäßig übersehen.

Warum Pentests bei Vibe-Coded Applications wichtiger werden

Gerade deshalb gewinnen unabhängige Sicherheitsanalysen zunehmend an Bedeutung. Bei KI-generierten Anwendungen reicht funktionales Testing häufig nicht mehr aus. Sicherheitskritische Komponenten müssen gezielt geprüft werden

Denn viele Schwachstellen entstehen nicht durch offensichtliche Fehler, sondern durch implizite Annahmen der KI während der Generierung. Und genau diese Annahmen werden im Entwicklungsprozess oft nicht hinterfragt.

Vibe Coding ist nicht das Problem. Blindes Vertrauen in generierten Code dagegen schon.

KI-Penetrationstest

Jetzt Ihre KI-Anwendung von den DigiFors-Experten testen lassen.